Intel Arc显卡安装Ollama

在Intel Arc独立显卡上安装运行Ollama

使用Ollama可以帮助你轻易的启动并运行 Llama 3.3、DeepSeek-R1、Phi-4、Gemma 3、Mistral Small 3.1 和其他大型语言模型。

在NVIDIA机器上,安装好应用程序和大模型后你几乎不需要任何配置,直接开始对话。

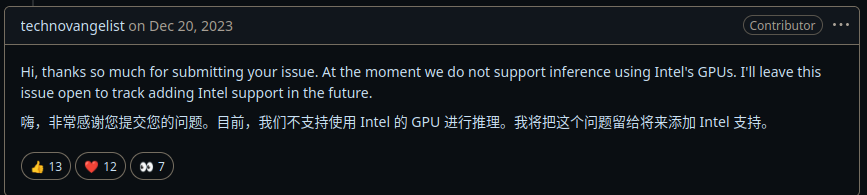

然而,你可能正在使用Intel Arc显卡,

如果你仍然继续以正常方式安装,你会发现它运行在CPU上

要继续使用Intel Arc显卡运行Ollama,需要额外的步骤

开始之前,请确认你的驱动程序版本不低于

31.0.101.5522,否则你需要升级你的驱动程序。确保你的主板BIOS已经启用了Resizable Bar功能

快速安装:使用Ollama Portable Zip

下载好解压后,windows用户运行start-ollama.bat即可运行Ollama服务,linux可以运行start-ollama.sh

打开另一个终端,输入./ollama run deepseek-r1:7b即可下载运行deepseek 7b模型。

更多模型参考Ollama Library

手动安装

安装Anaconda,选择对应的操作系统,下载完成后,根据你的操作系统安装软件的方式安装Anaconda。

安装完成后,打开Anaconda终端(Windows选择CMD终端),切换到当前用户主文件夹,依次执行每一行命令:

1 | |

这些命令对于Linux或Windows都适用

之后,初始化Ollama

Linux:

1 | |

Windows请用管理员身份运行终端以及其中命令:

1 | |

这会为你安装好llama.cpp

初始化完成后,如果需要更高效运行,建议设置变量:

Linux:

1 | |

Windows请在管理员终端运行命令:

1 | |

之后,初始化Ollama:

Linux:

1 | |

Windows管理员:

1 | |

之后会启用Ollama服务,你可以打开另一个终端并切换到相同目录运行./ollama run deepseek-r1:7b下载运行deepseek 7b模型。

以后可以打开终端运行./ollama serve即可打开ollama

Windows需要使用Miniforge Prompt运行此命令